폐막을 이틀 앞둔 8일 미국 라스베이거스에서 열리고 있는 세계 최대 가전?IT 전시회인 CES2026에서 모빌리티 분야의 주인공은 더욱 확장한 인공지능(AI)이라 할 수 있다.

특히 AI가 점차 자율주행을 위한 모든 신호를 하나로 묶는 구조로 진화하고 있음을 보여주고 있다. 내비 지도는 길 안내를 넘어 차량의 ‘예측(foresight)’이 되고 센서는 눈이 되며 학습 모델은 고도화되면서 판단을 맡게 됐다. 자율주행을 포함한 소프트웨어 정의차(SDV)는 결국 지도?센서?모델이 함께 훈련되고 검증되는 체계로 업그레이드 되고 있다.

이번에 여러 글로벌 기업들이 발표된 신기술들은 또 한번 진화한 모습을 보여주고 있다. 센서만으로는 부족한 맥락을 지도 AI가 보태고 그 위에서 주행 모델이 행동을 결정하는 식이다. 퀄컴 스냅드래곤 라이드와 결합한 AI 기반 지도 데이터를 ‘센서가 못 보는 앞날(foresight)’로 설명했다. 자율주행 AI도 ‘규칙 기반’에서 ‘추론 기반’으로 무게추가 옮겨갔다. 엔비디아는 안전을 전제로 한 추론형 자율주행 개발을 가속하는 알파마요(Alpamayo) 모델 및 도구 세트를 공개하며 학습과 검증을 하나로 묶는 방향을 분명히 했다. 지금의 정해진 조건에서 보조에 머물지 않고 희귀 돌발 상황을 더 많이 학습시키고 시뮬레이션으로 반복 검증하는 쪽으로 개발 문법을 바꿨다.

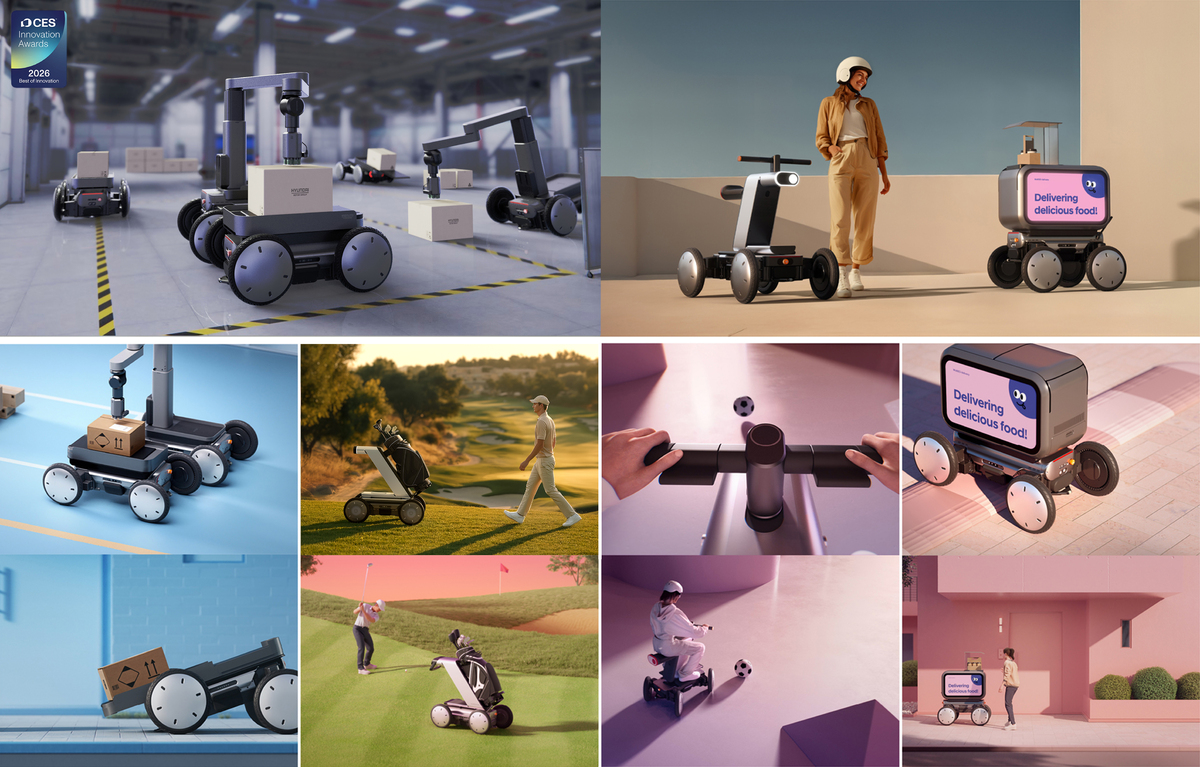

현대차그룹은 7일부터 10일까지 미국 라스베이거스에서 열리는 CES 2026에 참가해 그룹 AI 로보틱스 기술 개발 과정을 직접 경험할 수 있는 다양한 전시를 선보인다. 사진은 모베드(MobED) 상용화 모델 및 탑 모듈(Top Module) 결합 콘셉트 모델. 사진=현대차그룹 제공

현대차그룹은 7일부터 10일까지 미국 라스베이거스에서 열리는 CES 2026에 참가해 그룹 AI 로보틱스 기술 개발 과정을 직접 경험할 수 있는 다양한 전시를 선보인다. 사진은 모베드(MobED) 상용화 모델 및 탑 모듈(Top Module) 결합 콘셉트 모델. 사진=현대차그룹 제공 변화는 완성차의 연합전으로 이어진다. 현대차그룹은 이번 행사에서 AI 로보틱스 전략을 전면에 내세우며 ‘피지컬 AI(현실에서 움직이는 AI)’ 흐름에 합류했다. 현대차그룹 계열사인 보스턴다이내믹스의 휴머노이드 ‘아틀라스’를 공장에 적용해 2028년부터 투입하겠다는 계획도 공개했다. 자율주행이든 로봇이든 센서, 엣지 컴퓨팅, 학습 데이터가 겹치는 만큼 “모빌리티와 로봇이 같은 두뇌를 쓴다”는 선언에 가깝다. 뿐만 아니라 현대차는 차세대 자율주행 모빌리티 로봇 플랫폼 ‘모베드(Mobile Eccentric Droid, MobED)’로 로보틱스 부문에서 최고혁신상을 수상해 기술력과 제품 경쟁력을 동시에 인정받았다.

현대차의 행보는 ‘파트너십 경제’와도 맞물린다. 업계에서는 CES 현장에서 정의선 현대차그룹 회장과 젠슨 황 엔비디아 CEO의 비공개 회동 소식을 전하며 양사의 협력 확대 기대가 주가에까지 반영되기도 했다. SDV 전환에서 연산 인프라와 개발 스택은 비용이 큰 영역이다. 따라서 현실화된다면 완성차 업체는 AI 칩을 구매하는 고객사에서 AI 생태계를 공동 설계하는 동맹으로 성격이 바뀔 가능성이 크다.

이보다 앞서 현대차그룹 로보틱스 계열사 보스턴다이내믹스는 구글 딥마인드와 미래 휴머노이드 기술 개발을 위해 협력하기로 했다. 자사의 로보틱스 경쟁력에 구글 딥마인드의 AI 모델을 결합해 차별화된 기술을 내놓겠다는 구상이다.

정 회장은 이날 삼성전자 전시관을 찾아 AI와 로봇, 모빌리티 분야 협업 가능성을 언급하며 “저희와 같이 한번 콜라보 해보시죠”라는 즉석 제안을 던지기도 했다. 모빌리티 기업 총수가 글로벌 IT?가전사 부스를 직접 방문해 공개적으로 협업 의지를 드러낸 장면은 여러모로 상징적이라 할 수 있다.

한 자동차업계 관계자는 “결론적으로 지도 AI가 맥락을 주고 센서가 현실을 읽으며 학습 모델이 행동을 내리는 ‘AI 팀플레이’가 표준이 될 가능성을 봤다”며 “모빌리티는 이제 ‘운전 기술’이 아니라 AI 운영 체계로 경쟁하는 국면에 들어섰다”고 말했다.

김재원 기자 jkim@sportsworldi.com

![[포토] 폭설에 밤 늦게까지 도로 마비](https://image.ajunews.com/content/image/2025/12/05/20251205000920610800.jpg)

![[포토] 예지원, 전통과 현대가 공존한 화보 공개](https://image.ajunews.com/content/image/2025/10/09/20251009182431778689.jpg)

![[포토]두산 안재석, 관중석 들썩이게 한 끝내기 2루타](https://file.sportsseoul.com/news/cms/2025/08/28/news-p.v1.20250828.1a1c4d0be7434f6b80434dced03368c0_P1.jpg)

![[작아진 호랑이③] 9위 추락 시 KBO 최초…승리의 여신 떠난 자리, KIA를 덮친 '우승 징크스'](http://www.sportsworldi.com/content/image/2025/09/04/20250904518238.jpg)

![블랙핑크 제니, 최강매력! [포토]](https://file.sportsseoul.com/news/cms/2025/09/05/news-p.v1.20250905.ed1b2684d2d64e359332640e38dac841_P1.jpg)

![블랙핑크 제니, 매력이 넘쳐! [포토]](https://file.sportsseoul.com/news/cms/2025/09/05/news-p.v1.20250905.c5a971a36b494f9fb24aea8cccf6816f_P1.jpg)

![[포토]첫 타석부터 안타 치는 LG 문성주](https://file.sportsseoul.com/news/cms/2025/09/02/news-p.v1.20250902.8962276ed11c468c90062ee85072fa38_P1.jpg)

![[포토] 국회 예결위 참석하는 김민석 총리](https://cphoto.asiae.co.kr/listimg_link.php?idx=2&no=2025110710410898931_1762479667.jpg)

![[포토] 김고은 '단발 여신'](http://www.segye.com/content/image/2025/09/05/20250905507236.jpg)

![[포토] 발표하는 김정수 삼양식품 부회장](https://image.ajunews.com/content/image/2025/11/03/20251103114206916880.jpg)

![[포토] 박지현 '아름다운 미모'](http://www.segye.com/content/image/2025/11/19/20251119519369.jpg)

![[포토] 키스오브라이프 하늘 '완벽한 미모'](http://www.segye.com/content/image/2025/09/05/20250905504457.jpg)

![[포토] 알리익스프레스, 광군제 앞두고 팝업스토어 오픈](https://cphoto.asiae.co.kr/listimg_link.php?idx=2&no=2025110714160199219_1762492560.jpg)

![[포토] '삼양1963 런칭 쇼케이스'](https://image.ajunews.com/content/image/2025/11/03/20251103114008977281.jpg)

![[포토] 박지현 '순백의 여신'](http://www.segye.com/content/image/2025/09/05/20250905507414.jpg)

![[포토] 언론 현업단체, "시민피해구제 확대 찬성, 권력감시 약화 반대"](https://image.ajunews.com/content/image/2025/09/05/20250905123135571578.jpg)

![[포토] 김고은 '상연 생각에 눈물이 흘러'](http://www.segye.com/content/image/2025/09/05/20250905507613.jpg)

![[포토] 아이들 소연 '매력적인 눈빛'](http://www.segye.com/content/image/2025/09/12/20250912508492.jpg)

![[포토]끝내기 안타의 기쁨을 만끽하는 두산 안재석](https://file.sportsseoul.com/news/cms/2025/08/28/news-p.v1.20250828.0df70b9fa54d4610990f1b34c08c6a63_P1.jpg)

![[포토] 한샘, '플래그십 부산센텀' 리뉴얼 오픈](https://image.ajunews.com/content/image/2025/10/31/20251031142544910604.jpg)

![[포토]두산 안재석, 연장 승부를 끝내는 2루타](https://file.sportsseoul.com/news/cms/2025/08/28/news-p.v1.20250828.b12bc405ed464d9db2c3d324c2491a1d_P1.jpg)

![[포토] 키스오브라이프 쥴리 '단발 여신'](http://www.segye.com/content/image/2025/09/05/20250905504358.jpg)

![[포토] 아홉 '신나는 컴백 무대'](http://www.segye.com/content/image/2025/11/04/20251104514134.jpg)

![[CES 2026] "로봇이 스스로 판단"…현대차·기아, '온디바이스 AI 칩' 개발 완료](https://image.ajunews.com/content/image/2026/01/08/20260108152408588919.jpg)

![[CES 2026] 장재훈 현대차 부회장 "AI 전환 속도전…전사 역량 집중"](https://image.ajunews.com/content/image/2026/01/08/20260108092104599899.jpeg)

![[CES 2026] 현대위아 "로봇으로 제조·물류 완전 무인화…2028년 목표"](https://image.ajunews.com/content/image/2026/01/08/20260108090820364588.jpeg)

![[CES 2026] 현대모비스, 보스턴다이나믹스·퀄컴과 미래 모빌리티 협업](https://image.ajunews.com/content/image/2026/01/08/20260108083201354738.jpeg)